Alors que la compétition s’intensifie entre les startups (OpenAI, Anthropic…) et les géants numériques (Microsoft, Google, Meta…), l’adoption à grande échelle des modèles génératifs semble pour le moment compromise par la difficulté que les utilisateurs potentiels rencontrent à se projeter dans l’utilisation d’une interface conversationnelle et plus précisément dans la subtilité des prompts. Si l’impact de l’IA générative à moyen et long terme est certain, leur déploiement à court terme sera dépendant non pas de la puissance des modèles, mais de leur intégration aux outils existants.

#GenAI #FutureOfWork

En synthèse :

- Il existe de nombreux modèles génératifs accessibles via des chatbots proposant une interface conversationnelle

- Après plusieurs décennies d’utilisation d’interfaces graphiques, les utilisateurs sont fortement déroutés par l’obligation d’utiliser des commandes textuelles

- Le prompt engineering est une pratique empirique qui va considérablement freiner l’adoption de l’IA générative par la très large majorité des utilisateurs

- La clé d’un déploiement réussi à grande échelle réside dans une intégration des modèles génératifs aux flux de travail

- La valeur d’un modèle génératif ne se mesure pas à sa taille (le nombre de paramètres), mais à son utilité réelle (sa spécialisation à un domaine ou une tâche précise)

En à peine un an et demi, l’IA générative s’est imposée comme le nouveau fleuron des nouvelles technologies, la dernière innovation de rupture capable d’apporter une solution à l’ensemble des problèmes de l’humanité (stagflation, famine, guerres, transition écologique…).

Vous trouvez très certainement que j’en rajoute, pourtant, il n’existe visiblement pas de limite aux prévisions de croissance des modèles génératifs (Generative AI to Become a $1.3 Trillion Market by 2032). Parmi celles-ci, la promesse de complètement transformer notre façon de travailler et de créer de la valeur. S’il ne fait aucun doute qu’effectivement l’IA générative offre un potentiel gigantesque qui bouleversera notre façon de travailler à moyen terme et transformera l’économie à long terme (contribuant de façon majeure à la quatrième révolution industrielle), force est de constater que son impact à court terme est pour le moins limité, voir carrément imperceptible, sauf dans le petit cercle des initiés.

S’il existe en effet de nombreux services en ligne et APIs donnant accès à des modèles toujours plus puissants (GPT-4 Turbo, Gemini Ultra, Claude 3…), il est difficile pour le commun des mortels de se projeter dans les « bouleversements majeurs » annoncés, car la plupart des outils proposés sont cantonnés aux interfaces conversationnelles des chatbots, une réelle barrière à l’adoption pour des utilisateurs qui n’ont pas été éduqués aux interfaces à lignes de commande.

60 ans d’évolution en machine learning, mais 60 ans de régression en interface utilisateur

Il ne vous aura pas échappé que le maniement des modèles génératifs est de premier abord très laborieux, car tout se passe à travers une fenêtre de dialogue textuel, comme si vous deviez collaborer avec un collègue en échangeant des instructions par SMS. Un problème qui n’est pas récent, car déjà en 2016, les équipes d’IBM s’interrogeaient sur l’utilisatbilité de Watson : A guide to bot UX.

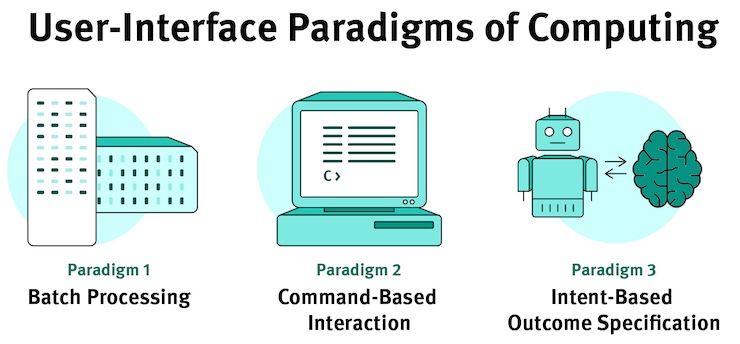

Effectivement, personne ne peut nier le fait que les interfaces conversationnelles peuvent être très déroutantes, car si on les désigne comme « naturelles », leur prise en main est contre-intuitive pour des utilisateurs habitués aux menus, boutons et liens : AI, the First New UI Paradigm in 60 Years.

Et encore, je fais référence aux services accessibles librement via un site web, car pour certains c’est encore plus compliqué à l’image de Midjourney qui est adossé à Discord :

Le problème des modèles génératifs est que le seul moyen d’interagir avec eux est de formuler votre demande en langage naturel, donc sous forme de questions et d’instructions. S’en suit alors un dialogue avec le modèle qui essaye de vous relancer avec de nouvelles questions :

Assez rapidement, les utilisateurs avancés se sont rendu compte qu’il était possible d’obtenir de meilleurs résultats en utilisant des instructions plus complètes et structurées, les prompts, qui sont l’équivalent des lignes de commande des interfaces des années 60, mais en langage naturel. S’il est, à priori, plus simple d’exprimer son besoin de façon naturelle, le faire de façon précise et efficiente requiert une certaine gymnastique d’esprit, c’est ce que l’on appelle le prompt engineering, l’art de programmer les modèles génératifs à l’aide de commandes en langage naturel.

Les prompts les plus sophistiqués peuvent ainsi être comparés à des mini programmes informatiques : ce sont une suite d’instructions et de précisions (des conditions) qui sont soumises à un système informatique (le modèle). On parle d’ailleurs de « construire » un prompt et non de « rédiger » un prompt. La différence avec l’informatique traditionnelle est que cette dernière repose sur des langages de programmation rigoureux avec des instructions précises qui fournissent toujours les mêmes résultats. Tout l’inverse des prompts qui reposent sur des instructions rédigées dans un langage de programmation approximatif avec une exécution aléatoire : un même prompt ne fournit jamais de réponses identiques.

Au final, le prompt engineering est une discipline empirique avec une courbe d’apprentissage très forte, pas du tout adaptée à la très large majorité des utilisateurs qui rechignent à changer leurs habitudes. Pour y remédier, il existe un certain nombre de ressources en ligne pour vous aider à mieux prompter, de même que des livres qui vous enseignent l’art et la manière. La lecture d’un ouvrage comme Hyperprompt permet de mieux appréhender la complexité de cette discipline et d’en identifier très rapidement les difficultés et limites.

Il existe également des services pour structurer et enrichir les prompts, mais ce sont des extensions de navigateur ou des services externes qui se rajoutent aux autres, et leur interface est encore plus déroutante. Nous sommes donc face à un réel point bloquant, et ça commence à se savoir : AI Chat Is Not (Always) the Answer.

Cela fait des mois que je questionne mon entourage, mes clients et les personnes que je peux croiser dans mon quotidien professionnel, et j’ai acquis la conviction que les modèles génératifs ne seront adoptés que s’ils sont intégrés aux outils existants. Je parle d’expérience, car de nombreuses nouvelles technologies et pratiques pourtant très prometteuses se sont heurtées à ce problème d’adoption : plateformes collaboratives, outils no-code…

Vous pourriez me dire que les enjeux de l’IA sont tellement élevés et le potentiel tellement important que les utilisateurs n’auront d’autres choix que de s’adapter et de changer leurs habitudes. Oui très certainement à terme, mais entre-temps, les acteurs historiques (Microsoft, Google, SalesForce…) auront su capitaliser sur les outils déjà déployés et adoptés. Sous cet angle, l’approche d’Adobe est à ce jour une des plus intéressantes, car ils bénéficient de l’apport de l’IA dans leurs outils depuis très longtemps (plus de 15 ans dans Photoshop, cf. ce compte-rendu : Adobe MAX08 – Jour 2).

Pas d’adoption de l’IA sans une intégration aux habitudes de travail

En toute honnêteté, je suis bien incapable de prédire ce qui va se passer dans 5 ou 10 ans. En revanche, ça fait plus d’1/4 de siècle que j’accompagne les entreprises dans leur transformation numérique et je peux vous garantir que l’inertie est considérable. À court terme, c’est à dire dans un délai de 1 à 2 ans, il me semble très hautement improbable que la grande majorité des utilisateurs se mettent enfin à changer leurs habitudes, alors qu’ils ont toujours rechigné à le faire jusqu’à présent. C’est comme si vous prétendiez que les utilisateurs vont abandonner leur écran d’ordinateur pour adopter les masques de réalité mixte tant la résolution est élevée.

La clé de l’adoption de l’IA générative à court terme est donc de ne pas perturber les flux de travail et de proposer les fonctions génératives au bon endroit et au bon moment, ne pas forcer les utilisateurs à ouvrir une nouvelle fenêtre de travail pour saisir un prompt et rapatrier la réponse. Dans la mesure où, les conditions de marché étant particulièrement dures en ce moment, il n’est pas question d’embaucher des équipes de prompteurs ou d’envoyer tout le monde en formation intensive, il va falloir se plier à cet impératif.

Pour que tout le monde puisse faire mieux avec moins

Comme mentionné plus haut, la période est délicate, car la pression concurrentielle n’a jamais été aussi élevée, tandis que les ressources n’ont jamais été aussi restreintes. C’est une équation réellement très complexe à résoudre, et elle se répercute sur toutes les activités des entreprises. En premier lieu dans le marketing et la communication où la multiplicité des canaux, supports et formats numériques impose aux équipes de devoir créer et adapter toujours plus de contenus. Les modèles génératifs sont bien évidemment des solutions tout à fait adaptées à cette tâche, mais dans la mesure où il n’est pas envisageable de recruter de nouveaux salariés ou prestataires à court terme, l’augmentation des capacités de production passe nécessairement par la montée en puissance des collaborateurs internes pour augmenter mécaniquement le nombre de personnes capables de créer / personnaliser des expériences (publications, campagnes, sites web, applications mobiles…).

C’est précisément sur ce point que la différence va se faire entre une startup lambda qui monopolise toutes ses ressources pour l’optimisation du modèle, et un éditeur qui bénéficie d’une réelle expérience pour la mise au point de solutions viables techniquement et fonctionnellement. Ainsi, de tous les géants numériques, les efforts réalisés par les équipes d’Adobe sont, selon moi, les plus louables, car ils n’ont pas cherché à rentrer dans la surenchère technique avec des modèles toujours plus puissants (qui reposent sur des billiards de paramètres et des contenus d’entraînement dont on ne connait pas la provenance), mais ont plutôt cherché à enrichir leur offre de façon cohérente et surtout viable.

Ceci se traduit par l’intégration de Firefly dans le Creative Cloud et de Sensei dans l’Experience Cloud, mais également dans la sortie de nouvelles solutions comme Adobe Express dont l’objectif est de mettre entre les mains de tous des outils très puissants jusqu’alors réservés aux professionnels.

En ce sens, ils démontrent une réelle ambition d’aller plus loin qu’ou outil équivalent comme Canva en s’appuyant sur l’IA générative : stimuler la créativité sans augmenter la difficulté. Comme vous pouvez le constater, ce n’est pas une interface pour manipuler un modèle génératif, mais bel et bien un environnement complet de création exploitant un modèle génératif pour simplifier / accélérer la création.

Une approche prudente et responsable de l’IA générative

Certains pourraient penser qu’Adobe est carrément en retard sur l’IA générative par rapport aux startups les plus en vues qui proposent des avancées techniques nettement plus impressionnantes, sauf que… c’est tout ce qu’elles proposent : des démonstrateurs techniques, et non des solutions viables pour le plus grand nombre. Ce n’est ainsi pas un hasard si certains pionniers de l’IA générative visuelle comme Stability se retrouvent en eaux troubles (Stability AI CEO resigns to ‘pursue decentralized AI’), c’est parce qu’elles se heurtent à des difficultés non pas d’ordre technique, mais juridique et commercial : elles ont mis au point un modèle, mais pas une solution.

Passés la lune de miel médiatique, nous commençons ainsi à mieux apprécier la stratégie prudente d’un éditeur historique comme Adobe qui, depuis le début, s’évertue à bien faire les choses avec notamment le recours à des modèles internes entrainés avec les contenus internes (Adobe Stock), et ceux de la communauté pour lesquels il existe un principe de rétribution des créateurs, ainsi qu’une traçabilité complète des contenus créés : Adobe starts paying bonuses to Stock contributors whose content is being used to train Firefly et Adobe created a symbol to encourage tagging AI-generated content.

Le but de la manoeuvre étant de miser sur le long terme et non de surfer sur la hype du moment, au risque de s’exposer rapidement aux redoutables recours collectifs des ayant droit qui sont en train d’être montés contre les éditeurs / pirates (Adobe is so confident its Firefly generative AI won’t breach copyright that it’ll cover your legal bills). Mais pas seulement…

La visite d’un service en ligne comme Firefly vous permettra ainsi de bien comprendre la différence d’approche entre un laboratoire de recherche qui met à disposition un démonstrateur technique (oui c’est bien d’OpenAI et de Dall-E dont je parle) et une solution prête à l’emploi. Je trouve ainsi l’interface de Firefly nettement plus intuitive que les modèles concurrents :

Le but de ce site web n’étant pas de proposer un service en ligne payant, mais d’exposer l’approche d’Adobe et de démontrer son savoir-faire en matière de conception d’interfaces pour des solutions à destination des professionnels.

L’important n’est pas le nombre de milliards de paramètres du modèle, mais son utilité réelle

Certains géants numériques ont fait le choix de sortir leur chéquier pour s’imposer le plus rapidement possible sur une niche à forte croissance (ex : Microsoft), tandis que d’autres ont choisi de développer des solutions en interne pour en avoir une meilleure maitrise (ex : Meta, Google et Adobe).

C’est cette conception interne qui permet notamment à Adobe de proposer des modèles optimisés sur certaines tâches dont ils ont pour le moment l’exclusivité. C’est notamment le cas des fonctions « text-to-vector graphic » (Adobe Firefly’s generative AI models can now create vector graphics in Illustrator) ou « text to model » intégrées à Express (Adobe Firefly can now generate more realistic images). Cette intégration permet d’enrichir les fonctionnalités déjà présentes avec des capacités génératives pour plus de productivité (cela concerne plutôt les agences) ou plus d’autonomie (cela concerne plutôt les annonceurs).

L’offre d’Adobe ne se limite bien évidemment pas à ces modèles spécialisés puisque l’on retrouve également un modèle « text to text » plus classique proposé par Sensei qui permet de faire un certain nombre de manipulations sur des contenus textuels, idéal pour les community managers qui doivent optimiser les publications et se renouveler sans cesse.

Tout ceci est très intéressant, mais j’ai l’impression qu’Adobe est encore très TRÈS loin de démontrer tout son potentiel pour tout ce qui touche aux contenus textuels, surtout avec l’héritage du Document Cloud. Certes, la version desktop d’Acrobat propose maintenant un assistant capable de faire des synthèses ou de répondre à des questions relatives au contenu d’un fichier PDF (Adobe Acrobat adds generative AI to ‘easily chat with documents’), mais leur ambition va beaucoup plus loin (Adobe’s next generative AI frontier: Digital documents)

Sur ce domaine, ils se sont d’ailleurs trouvé un partenaire de choix : Adobe Partners with NVIDIA to Harness the Power of PDF Intelligence with Next-Gen LLMs.

Mais là, nous ne faisons qu’explorer la partie visible de l’iceberg, car nous n’évoquons que les fonctions de génération et manipulation de contenus textuels ou visuels. Ainsi, après la création augmentée par l’IA, nous pourrions tout à fait imaginer l’engagement augmenté par l’IA grâce à des chatbots de marque qui seraient utilisés pour interagir avec des prospects et clients sur les médias sociaux à travers les commentaires. Assurément un tout nouveau champ d’exploration plein de promesses, mais qui n’est pas sans danger (augmentation drastique de la pollution, méfiance des utilisateurs…).

Toujours est-il que jusqu’à preuve du contraire, si les capacités techniques des modèles génératifs sont très impressionnantes, elles ne pourront être exploitées à grande échelle qu’à travers des outils qui ne perturbent pas le quotidien des utilisateurs.

L’adoption passe par l’intégration, pas par la révolution

Si vous vous intéressez au sujet de l’IA générative, vous avez certainement dû être exposé à des prédictions sensationnelles ainsi que des promesses mirifiques. Mais je pré-suppose que vous n’êtes pas si naïf et que vous vous doutez bien qu’il n’y aura pas de changement rapide et radical des habitudes de travail, car il en a toujours été ainsi, et il en sera ainsi, même avec la sortie prochaine de GPT-5.

Plus que de nouveaux modèles ou outils, les collaborateurs (créatifs ou non) ont besoin d’un environnement de travail simple et accessible pour réellement gagner du temps, et c’est là où les éditeurs déjà bien installés comme Adobe savent faire la différence : en mettant au centre de leurs préoccupations non pas l’exploit technique, mais la viabilité de leurs solutions (confort d’usage, facilité de prise en main, légalité…).

Il va s’en dire bien évidemment que nous n’en sommes qu’au tout début d’une longue feuille de route d’évolution de l’offre d’Adobe et que le reste à faire est gigantesque. J’attends ainsi avec grande impatiente la possibilité d’éditer chacun des éléments des images générées, comme le propose le projet Stardust présenté l’année dernière, et dont j’adorerais avoir des nouvelles…

Mais plutôt que de spéculer, j’attends de voir ce qui va être présenté lors de la nouvelle édition du Adobe Summit, la Grande Messe annuelle des professionnels du marketing et de la communication. Je serai à Las Vegas la semaine prochaine pour assister à cet événement et tenter d’en savoir plus sur ce qu’ils nous préparent, et surtout pour essayer d’anticiper la direction que va prendre le marché.