Cette semaine, le gratin du numérique est à Las Vegas pour une nouvelle édition du CES, qui sans surprise, est cette année quasiment exclusivement centrée sur l’IA. Si vous pensiez que nous avions atteint le point de saturation sur le sujet, il va falloir vous faire à l’idée que l’IA est une lame de fond qui va déferler pendant de nombreuses années. Le problème, est que l’on essaye de nous vendre un maximum de radeaux de sauvetage en un minimum de temps. Peut-être serait-il plus opportun d’aider les passagers de ce navire à la dérive de ne pas redouter la mer et à mieux apprécier tout ce qu’elle a à nous offrir. Une métaphore pas très inspirée, je l’avoue, mais qui illustre bien la situation ubuesque dans laquelle nous nous trouvons.

En synthèse :

- Deux ans après la sortie de ChatGPT, la compétition est toujours aussi féroce entre les éditeurs qui cherchent à créer des modèles génératifs toujours plus performants sans se soucier de leur viabilité économique ou écologique ;

- Les éditeurs et prestataires surfent sur le raz-de-marée médiatique de l’IA et s’efforcent de lister le plus de cas d’usage possible pour stimuler l’adoption de l’IA générative ;

- Face à une technologie qu’ils ne comprennent pas et des perspectives d’évolution angoissantes pour eux, les salariés lambda se montrent peu enthousiastes, voire méfiants (à juste titre) ;

- Plus de promesses ou de scénarios alarmistes sur les pertes d’emplois ne changeront pas la donne, l’adoption ne sera facilitée qu’avec une pédagogie adaptée à la hauteur des enjeux de l’IA (4e révolution industrielle) ;

- L’important n’est pas d’apprendre à prompter sur les derniers modèles, mais de faire comprendre la nature des changements à des collaborateurs qui vont devoir bouleverser leurs méthodes et habitudes de travail à long terme.

Je ne sais pas pour vous, mais j’ai le pressentiment que pour ce qui concerne les technologies et usages numériques, 2025 sera le prolongement de 2024 : une compétition féroce entre les éditeurs pour sortir le modèle génératif le plus puissant (La course à la domination de l’IA).

Nous ne sommes qu’au tout début de l’année, et l’intensité concurrentielle est déjà à un très haut niveau avec la sortie d’un nouveau modèle chinois censé égaler, voir dépasser les performances des meilleurs modèles américains : The Quiet Giant Leading China’s AI Race.

Ce DeekSeek V3 R1 est-il réellement meilleur que GPT-4o ou Sonnet 3.5 ? Impossible de le déterminer réellement, car nous manquons d’outils d’évaluation fiables, et car il faudrait prendre en compte d’autres facteurs (ex : coûts d’entrainement et d’inférence, vitesse… cf. New o1 benchmark raises more questions about AI benchmarking in general).

La course à l’IA généraliste devient visiblement une obsession pour les acteurs du numérique, d’autant plus depuis que le patron de ChatGPT a révélé qu’il savait comment y parvenir (OpenAI’s Sam Altman says ‘we know how to build AGI’) et que son dernier modèle expérimental s’en rapprochait, mais en omettant que les coûts pour faire tourner ce modèle qui sont ridiculement élevés (on parle de plusieurs centaines de dollars par question : OpenAI’s o3 Model Shows AI Scaling Continues, But at a Cost).

Je déplore cette sempiternelle course à l’échalote, car elle ne nous mènera nulle part, si ce n’est à un épuisement de nos ressources naturelles. Tout ça pour quoi ? C’est justement une grosse partie du problème actuel.

Des nombreux cas d’usage, mais pas réels besoins ou envies

La vérité difficile à entendre par les techno-optimistes est que nous avons des modèles largement assez puissants pour pouvoir faire la différence avec les outils informatiques traditionnels, plus de puissance ne changera pas la donne. Ce dont nous avons réellement besoin pour gagner en productivité est d’optimiser ces modèles et de les déployer à grande échelle.

Problème : malgré tous les efforts réalisés par les éditeurs ces deux dernières années pour forcer l’adoption de l’IA générative, la majeure partie des salariés ne sont pas prêts. Pour s’en convaincre, il suffit de constater ce à quoi s’évertuent tous les cabinets conseil et ESN de France et de Navarre : définir des cas d’usage. C’est un peu comme si on listait toutes les destinations accessibles en voiture pour vous motiver à passer votre permis de conduire.

Le constat que je peux faire est le suivant : Si vous avez besoin de lister et de décrire des cas d’usage, c’est que les utilisateurs n’ont aucune idée de ce qu’est l’IA, de ce à quoi elle peut leur servir, et surtout qu’ils n’ont pas envie de s’y intéresser !

Dans ces conditions, forcer l’adoption n’est pas la bonne chose à faire, car cela peut provoquer de la suspicion chez les utilisateurs. À juste titre, car personne n’est dupe quant aux motivations des entreprises : compresser (encore plus) les délais et coûts pour gagner en productivité. Cette quête de la performance à travers l’adoption forcée de l’IA engendre naturellement une résistance au changement qui coûte du temps et de l’argent, or c’est justement ce que l’on souhaite économiser, quel paradoxe !

Les éditeurs et promoteurs de l’IA tentent de masquer cette réalité avec des promesses toujours plus fortes, mais le scepticisme l’emporte logiquement : Silicon Valley stifled the AI doom movement in 2024. Soit, il suffit juste de promouvoir une lessive qui lave encore plus blanc.

L’argument éculé de l’innovation technologique

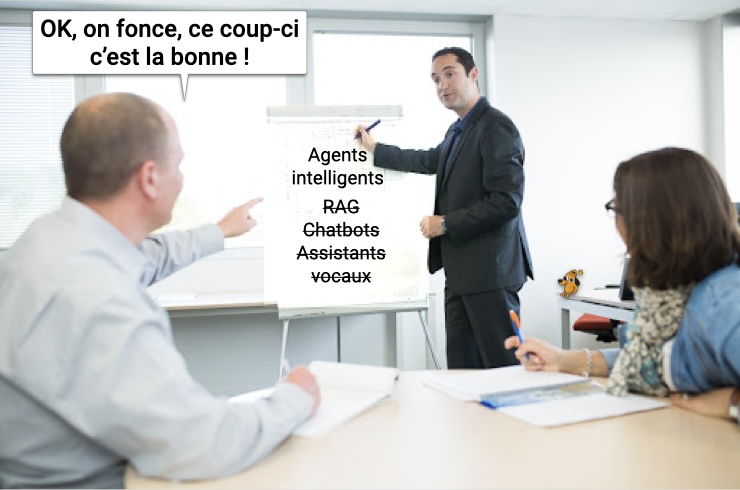

Comme toujours dans la plus pure tradition de la Silicon Valley, on nous présente la dernière innovation comme LA solution à tous les problèmes, ceux que la précédente innovation étaient censée régler (cette année ce sont les agents intelligents).

Entendons-nous bien : je ne suis pas en train de critiquer ou de minimiser le potentiel des agents intelligents (j’ai d’ailleurs publié plusieurs articles à leur sujet : Web agentisé : quand l’industrie de l’IA cherche sa nouvelle ‘Next Big Thing’ et Les agents intelligents sont-ils les nouveaux navigateurs web ?), je m’efforce simplement de relativiser l’enthousiasme d’éditeurs qui sont un peu trop pressés de rafler la mise sans trop se soucier des besoins réels ou du niveau de maturité des utilisateurs.

La vérité est que nous n’en sommes qu’au tout début d’une évolution majeure de l’outil informatique, un changement de paradigme équivalent au cloud computing ou à l’arrivée des smartphones, avec une adoption lente, mais progressive. Le souci est qu’écrire cette vérité n’est pas très vendeur. Les médias et consultants privilégient donc largement le discours de l’innovation de rupture qui est bien plus aguicheur et surtout valorisant.

Ne vous y trompez pas : Dire en 2025 que l’IA va tout balayer et bouleverser le monde du travail est comme de dire en 1985 que l’informatique va tout balayer et bouleverser le monde du travail : une prévision très vague, insipide, sans réelle prise de risque ni conviction. C’est simplement un moyen d’attirer l’attention, d’occuper l’espace médiatique.

Et là, nous n’abordons même pas le problème environnemental, car si la quantité d’énergie nécessaire pour l’entraînement des nouveaux modèles est en baisse, la quantité d’énergie nécessaire pour les faire tourner augmente de façon linéaire avec le nombre d’utilisateurs que l’on force à utiliser des outils dont ils ne voient pas (pour le moment) l’utilité. Cherchez l’erreur…

J’ai l’intime conviction que cette fuite en avant est néfaste à la fois pour la planète (quantités limitées de charbon, uranium, eau douce, silicium…), mais également pour la très large majorité des utilisateurs qui sont toujours pénalisés par une dette numérique que personne n’ose assumer. Il en résulte cette situation ubuesque où l’on demande aux salariés de s’auto-former aux techniques avancées de prompting alors qu’ils ont encore du mal à gérer leurs emails.

Ce dont les cols blancs ont réellement besoin, n’est pas d’une nouvelle série d’outils reposant sur des modèles génératifs toujours plus puissants gourmands (Training Compute of Frontier AI Models Grows by 4-5x per Year), mais d’explications simples et d’un accompagnement pour ce qui s’annonce comme un changement majeur dans l’exploitation des outils informatiques.

Plus de puissance ne changera pas la donne, car si l’adoption est plus lente qu’espérée, ce n’est pas une question de manque de performance des modèles, mais plutôt du manque de connaissances et de compétences.

Plus de pédagogie > Plus d’innovation

Si vous lisez ce blog régulièrement, alors vous avez pu constater que je m’efforce depuis près de deux ans à décrypter la « révolution de l’IA » et à prendre du recul sur la fuite en avant pratiquée par de nombreux éditeurs qui voient dans les progrès successifs des modèles génératifs l’opportunité de conquérir de nouveaux marchés.

Après deux ans de brouhaha médiatique et cacophonie technologique, je pense ne pas me tromper en écrivant que nous arrivons aux limites des discours reposant sur des promesses irréalistes ou sur la peur du déclassement professionnel (ex : « Vous ne serez pas replacé par l’IA, mais par quelqu’un qui utilise l’IA« ). Mais comme toujours, l’esbroufe l’emporte sur le pragmatisme, et on se retrouve avec des légions de pseudo-experts de l’IA sur l’LinkedIn qui commentent inlassablement les derniers score de benchmarks de tel ou tel modèle.

Tout comme on ne juge pas une voiture à la puissance de son moteur, il est trompeur de comparer les modèles entre eux sur des critères quantitatifs (ex : nombre de paramètres, score à tel ou tel benchmark… cf. Toutes les IA ne sont pas les mêmes, arrêtez de les comparer).

L’important n’est pas la puissance brute du modèle, mais la qualité et la pertinence des contenus ayant servi à son entrainement (d’autant plus qu’il y a un terrible déficit de transparence sur les modèles actuels : L’embarrassante question de l’origine des données d’entrainement des IA génératives). Une règle immuable qui s’applique à toutes les méthodes d’apprentissage automatique : De l’importance des données (et des humains) pour le machine learning. Les petits modèles spécialisés offrent ainsi un bien meilleur ratio compétences / consommation d’énergie que les modèles XXL que les éditeurs exhibent comme des animaux de foire pour nous faire payer un abonnement, mais sans parvenir à les rentabiliser (OpenAI is losing money on its pricey ChatGPT Pro plan).

Mais revenons au sujet principal de cet article : le déficit de pédagogie, qui est un frein à l’adoption. Ainsi, je persiste à croire que nous n’avons pas besoin de plus de techno-prophètes qui nous répètent encore et toujours les mêmes inepties sur l’IA (Des dangers du dogmatisme technologique). Ce dont les potentiels utilisateurs ont besoin pour adopter sereinement les outils reposant sur des modèles génératifs est de plus de pédagogie : (ré)expliquer ce qu’est l’IA, ce qu’elle permet de faire ou ne pas faire, la façon dont elle le fait différemment des outils informatiques traditionnels, les différents types d’IA…

Cela fait plus d’un an que je forme régulièrement des professionnels de tous les secteurs à l’IA générative, et je peux vous affirmer que ce qu’ils réclament est à la fois une prise de hauteur (la façon dont leur métier va changer dans les prochaines années) et plus de pragmatisme (ce qu’ils peuvent faire dès leur retour à leur bureau). Un déficit de pédagogie sur ces deux aspects ne peut que générer de la confusion et de la suspicion chez des salariés déjà largement assez pressurisés (L’intelligence artificielle fait peur, surtout à ceux qui ne font pas l’effort de la comprendre).

<Pub>

Dans ce cadre, je vous rappelle que j’édite un feuillet pédagogique que je viens juste de mettre à jour (Le B-A-BA de l’IA) et que je propose des packages d’acculturation numérique pour préparer vos collaborateurs aux nombreux changements à venir, et à l’avènement de l’IA générative en particulier.

</Pub>

Pourquoi se donner autant de mal pour sensibiliser les salariés à l’IA ? D’une part, pour ne pas répéter les erreurs du passé (adoption chaotique des outils bureautiques et numériques) ; et d’autre part, pour les préparer à des changements d’habitudes et de façon de travailler qu’ils ne soupçonnent même pas. La plus grosse erreur à faire serait de les initier au prompt et d’omettre l’impact psychologique des bouleversements à venir (parer au plus urgent et les laisser se débrouiller pour la suite).

Je peux tout à fait concevoir qu’il y a un sentiment d’urgence à adopter l’IA générative inculqué par les éditeurs et médias, mais il nous faut impérativement apprendre de nos erreurs passées et ne pas sur-évaluer l’impact à court terme tout en sous-évaluant l’impact à long terme.

Mieux travailler > Travailler plus vite

En conclusion, je ne pourrais que trop vous conseiller de ne pas prêter trop d’attention aux scénarios (bien trop) optimistes, et de vous détacher des scénarios (bien trop) pessimistes pour pouvoir rester concentrer sur l’essentiel : faire mieux avec moins, car dans tous les cas de figure, le principal levier de progrès / performance pour les travailleurs du savoir est méthodologique et non informatique (Les entreprises n’ont pas besoin de meilleurs modèles génératifs, mais d’IA mieux intégrées).

Pour mieux s’adapter à un monde complexe, incertain et en évolution permanente, les entreprises ont surtout besoin de souplesse et de réactivité, pas d’outils miracles. Mais ça vous le saviez déjà, non ?