Le géant américain essaie toujours de gagner la bataille de l’IA. Les nouveautés annoncées montrent un réel effort dans ce sens.

AI Overviews, la réponse générée par IA dans les pages de recherche de Google, déjà aperçu en Italie, en Allemagne et en Suisse, pourrait s’étendre prochainement en France. Et selon la firme de Mountain View, AI Overviews devrait muscler ses fonctionnalités, avec l’introduction de Gemini 2.0. “Auparavant, les réponses fournies ne ciblaient pas l’intention de l’utilisateur, et répondaient parfois à côté du sujet, ou fournissait des informations expirées”, explique Jean-Baptiste Bessière, head of SEO au Club Med. “L’introduction de Gemini 2 va permettre aux AI Overviews de bien mieux répondre à l’intention de l’utilisateur.”

Pour cela, Gemini 2. 0 lance différentes recherches, en parallèle de différents sous-thèmes. Celles-ci sont accomplies sur des informations “étayées par des résultats de haute qualité provenant du web”, selon le géant américain. Cela doit lui permettre de fournir de meilleures réponses. Les événements d’actualité où “la précision à la minutes près est essentielle”, ne devraient pas afficher d’AI Overviews. Google essaiera aussi d’identifier si la mise en place d’un lien dans la réponse est pertinente.

AI Mode pour une expérience plus conversationnelle

Autre annonce de Google : le lancement de l’AI Mode. L’expérience est disponible en anglais pour les utilisateurs de plus de 18 ans aux Etats-Unis qui ont opté pour l’expérience via Labs. Les abonnés à Google One AI Premium sont les premiers invités à y tester cette expérience.

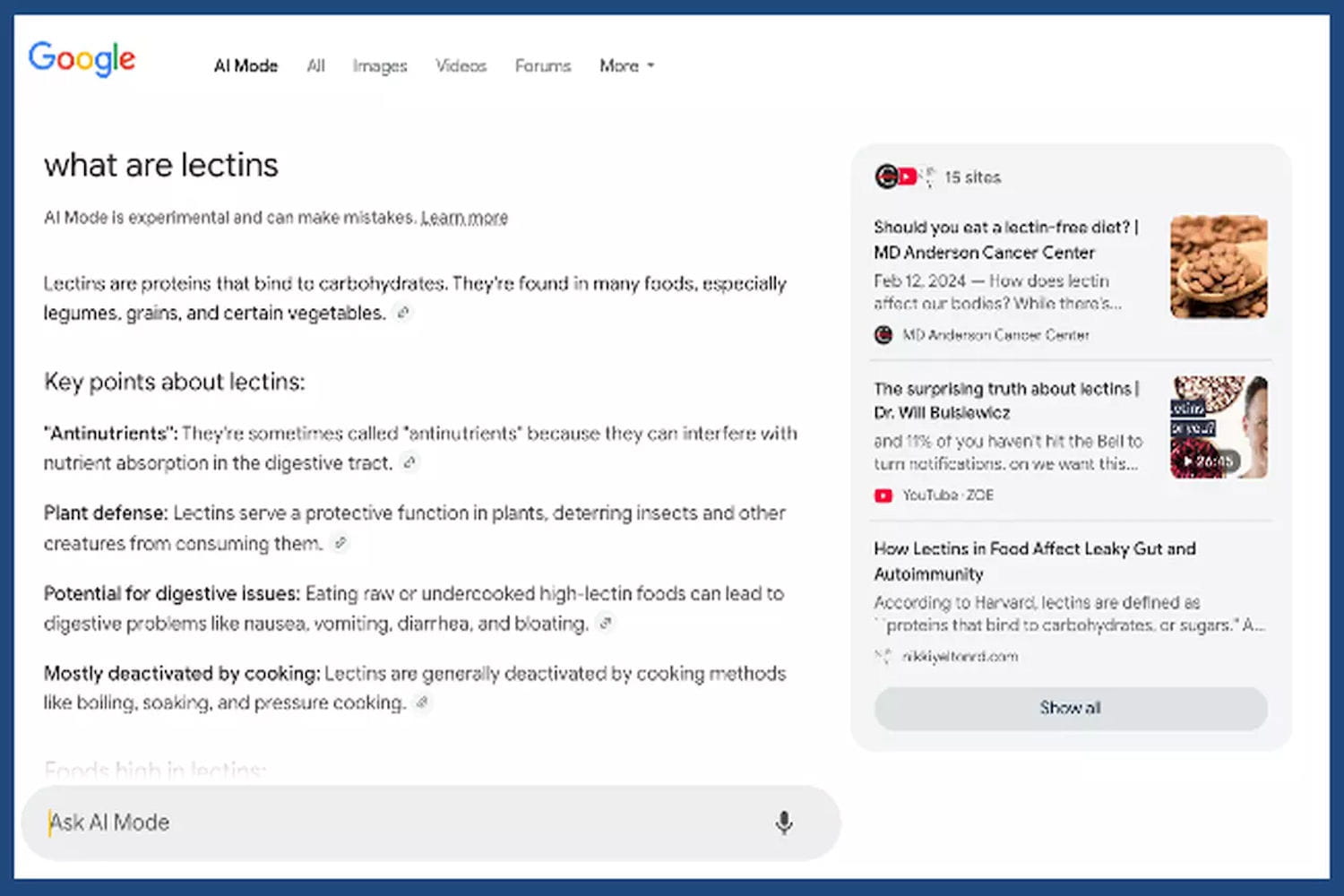

D’après les tests effectués, AI Mode s’affiche sur l’interface du Search dans une section à côté de “All”, “Shopping”, “Forums ” ou “Images”. L’interface apparait particulièrement épurée, vierge de publicité, pour l’instant. Cela pourrait d’ailleurs changer si le succès est au rendez-vous.

Sous le capot, les fonctionnalités de Gemini 2.0, comme le raisonnement avancé. La firme de Mountain View espère notamment améliorer la véracité des réponses fournies.” En collaboration avec les équipes de recherche Google Deepmind, nous utilisons l’apprentissage par renforcement (RL) agentique dans notre formation personnalisée pour récompenser le modèle à générer des déclarations qu’il sait plus susceptibles d’être exactes (et non hallucinées) et également étayées par des entrées”, révèle le géant américain. “Le RL agentique encourage également le modèle à récupérer et ajouter des informations factuelles supplémentaires à ses affirmations à partir de sources d’informations telles que notre Knowledge Graph.” Cela le différencie de concurrents comme Perplexity , qui se sert uniquement du web pour fournir ses réponses. Pour Laurent Jean, spécialiste de l’IA et du SEO, l’AI Mode devrait ainsi afficher des réponses dans “beaucoup plus de requêtes et de questions plus complexes que les AI Overviews actuels, car il utilise des modèles plus avancés.”

Google apprend aussi à son modèle quand et comment lier les informations. Par exemple, il pourra décider d’inclure des hyperliens différents selon que l’utilisateur souhaite effectuer telle ou telle action. Notons que l’on trouve actuellement sur les réponses générées des carrousels de liens et des icones en forme de cadenas, ainsi que des sources à droite du texte généré.

Les requêtes précédentes pourraient aussi influencer la réponse d’AI Mode, selon Laurent Jean. “Tous les éditeurs de solutions de LLMs sont en train de rajouter une couche “Memory” pour qu’il y ait un historique des conversations. Ce qui fait que la présentation d’une réponse sera conditionnée par rapport aux interactions précédentes. Et donc, Google saura exactement où se trouve l’utilisateur dans son parcours sur ses intentions de recherche.”

Selon Greg Sterling, cofondateur de Near Media, l’expérience est d’ailleurs bien meilleure que celle sur AI Overviews. Pour lui, l’effort de combiner les différents “graphes”, comme les données locales, la recherche sur le Web et l’IA conversationnelle est positif du point de vue de l’utilisateur.

Des questions restent cependant à régler, comme celles liées à la protection de la vie privée. L’utilisation d’AI Mode nécessite d’activer l’historique des recherches et le paramètre “Activité sur le Web et les applications”, qui enregistre les recherches et d’autres activités sur Google. Une façon peut-être pour le géant américain, sous couvert de personnalisation des résultats de la recherche de l’IA, de saisir les données de l’utilisateur. Egalement, pour l’instant, la Search Console ne permet pas d’avoir des données sur AI Mode.

Des visiteurs moins nombreux et plus qualifiés ?

Du côté des référenceurs interrogés, si la transformation de Google en moteur de réponse n’est pas une surprise, la crainte d’une perte du trafic organique ressurgit. Les requêtes sans clic sont, comme souvent avec l’IA générative, particulièrement redoutées. “Cela empêche l’entrée dans le funnel de conversion des utilisateurs”, exprime Jean-Baptiste Bessière. “On peut donc s’attendre à des pertes de clics et conversions sur les requêtes présentant des AI Overviews.” Indiquons que d’après un tweet de Wil Reynolds, CEO de Seer Interactive :”les chatbots d’IA envoient 96% de trafic en moins sur les sites web des éditeurs que les moteurs de recherche traditionnels.” Si le chiffre donné peut paraitre particulièrement important, différentes études montrent une perte de trafic organique lié à AI Overviews.

Mais des motifs d’espoir apparaissent également. D’après les essais, les liens sont affichés régulièrement à la fin des paragraphes. Ce qui distingue Google de certains concurrents, qui affichent une simple liste de sources une fois le texte généré. La meilleure compréhension de l’intentionnalité de la requête pourrait aussi amener un trafic plus qualifié, sur les recherches commerciales notamment.

“Google va également passer au déploiement de fonctionnalités de réalité augmentée, dont il avait parlé en 2023”, pointe Laurent Jean. “Les personnes vont par exemple pouvoir essayer une couleur de cheveux en activant leur caméra ou porter un vêtement selon leur corpulence. Il y aura des choses à préparer de ce côté là pour les e-commerçants.”

De façon générale, l’EEAT, avec la mise en avant de l’expérience, le contenu à valeur ajoutée, textuel, ou encore vidéo, pourraient être particulièrement intéressants à travailler. Certainement dans ce sens, Gary Illyes, analyste chez Google, déclarait récemment que l’originalité allait être quelque chose de très important pour 2025.