L’IA générative redessine les contours de notre société en consolidant le pouvoir d’une poignée de grandes sociétés technologiques qui investissent massivement dans des modèles toujours plus puissants et polyvalents. Cette concentration inédite de pouvoir économique et technologique fait émerger un nouveau paradigme socio-économique : le techno-féodalisme, où citoyens et entreprises deviennent progressivement dépendants d’infrastructures numériques contrôlées par quelques conglomérats étrangers. Au-delà de la simple transformation des méthodes de travail, cette révolution questionne notre autonomie intellectuelle et notre capacité collective à maîtriser une technologie qui pourrait redéfinir les rapports de force mondiaux. Entre promesses d’augmentation de la productivité et risques d’asservissement technologique, l’enjeu devient celui de notre souveraineté face à des outils qui façonnent déjà notre quotidien professionnel et personnel.

En synthèse :

- Une poignée d’acteurs (Google, Microsoft, Meta, Amazon…) investissent massivement dans des modèles d’IA générative universels, consolidant une position dominante sans précédent ;

- Les assistants numériques s’imposent dans nos usages quotidiens, personnels et professionnels, jusqu’à remodeler nos comportements, notre attention et nos processus décisionnels ;

- L’utilisation intensive des chatbots encourage la paresse intellectuelle et réduit l’activité cérébrale, créant une dépendance croissante qui renforce mécaniquement l’hégémonie des IA ;

- L’avènement de l’IA alimente la 4e Révolution Industrielle qui redéfinit les rapports de force mondiaux, concentrant richesses et influence entre les mains de ceux qui maîtrisent ces technologies, une dynamique qui risque de creuser les écarts de développement entre les nations, menant à des inégalités accrues à l’échelle mondiale.

- Face à ces bouleversements, seule une réappropriation collective des outils numériques et une formation massive sur l’IA peuvent éviter l’asservissement technologique et préserver notre autonomie décisionnelle.

Avec ce troisième article, je termine mes réflexions sur l’évolution du marché de l’IA générative, et son impact sur notre quotidien. Si l’on récapitule ce qui a été dit dans mes deux précédents articles : Google et Microsoft affichent de très grosses ambitions sur l’IA, mais Meta et Amazon ne sont pas en reste, avec pour chacun des modèles universels dans leur spécialité (cf. Les LLMs ne sont qu’une étape du plan d’ensemble de Google et Bientôt un « Work Model » universel sur votre PC ?).

Vous noterez qu’ils ne sont pas les seuls, car Elon Musk mobilise son immense fortune pour se maintenir en tête de la course, notamment grâce aux équipes de xAI qui viennent de publier le très impressionnant Grok 4, le nouveau modèle de référence : Elon Musk’s xAI launches Grok 4 alongside a $300 monthly subscription.

Là aussi, Elon Musk affiche une grande ambition puisqu’il se donne pour mission de créer un modèle universel d’actualités avec des points de vue équilibrés : Elon Musk wants to rewrite « the entire corpus of human knowledge » with Grok.

Mais ce n’est pas tout, car nous devons aussi compter avec SalesForce (Einstein se positionnant comme un modèle universel de service) et Adobe (Firefly en tant que modèle universel de création) ainsi que tous les autres grands éditeurs (IBM, Oracle, Hubspot…).

Bref, tout ça pour dire que des centaines de milliards de dollars sont investis tous les ans pour perfectionner des modèles génératifs qui deviennent de plus en plus puissants et polyvalents, pour vous en convaincre, je vous invite à consulter les statistiques et graphiques suivants : Artificial Analysis AI Trends.

Notre quotidien sera-t-il à terme entièrement piloté et dépendant d’une dizaine d’éditeurs de modèles génératifs ? Il y a de fortes chances…

Les IA comme coachs de notre quotidien pro / perso

La question de la place qu’occupent les big techs dans nos vies n’est pas anodine, car il faut bien reconnaitre que nous sommes actuellement extrêmement dépendants d’une petite dizaine de services en ligne / applications mobiles (Gmail, YouTube, Instagram, WhatsApp, TikTok, Amazon, LinkedIn, Teams…).

Est-il trop tôt ou encore temps pour s’en soucier ? Je n’ai pas la réponse à cette question, mais je sais en revanche que la montée en puissance des assistants numériques est inexorable. Si l’on peut faire confiance aux grands éditeurs (Google, Apple, Meta…) qui sont effectivement très entreprenants dans la monétisation via la publicité, mais qui sont surveillés de près par les autorités et soumis au vote de confiance des actionnaires, les nouveaux venus comme OpenAI sont en revanche exemptés de tout compte à rendre, puisque se sont des sociétés privées.

C’est le principal avertissement qui est émis par l’IA Now Institute dans son dernier rapport, Artificial Power, dont vous trouverez les conclusions ici : Executive Summary. Pour eux, le constat est sans appel sur la position dominante du couple OpenAI / Microsoft :

“The question we should be asking is not if ChatGPT is useful or not, but if OpenAI’s unaccountable power, linked to Microsoft’s monopoly and the business model of the tech economy, is good for society.”

Et au cas où vous n’auriez pas su lire entre les lignes, ils enfoncent le clou dans la conclusion :

« The World We Want (and Why the Current Trajectory of AI Won’t Get Us There) »

J’aimerai pouvoir être plus optimiste qu’eux, mais je ne vois pas comment nous pourrions infléchir la montée en puissance des IA génératives jusqu’à ce qu’elles occupent une place primordiale dans notre quotidien, comme l’ont fait les ordinateurs (quotidien pro) et les smartphones (quotidien perso). Le danger de cette omniprésence est que chacun de ces outils (logiciels, applications mobiles, chatbots…) grignote une part toujours plus importante de notre attention, de notre budget, de notre cerveau, jusqu’à redéfinir complètement notre quotidien : De la nécessité d’un nouveau contrat social pour homo numericus.

Au vue du rythme d’adoption de l’IA générative, notre dépendance à des outils numériques contrôlés par une poignée de conglomérats va s’accroitre jusqu’à devenir irrévocable, accordant ainsi aux big techs un pouvoir sans équivalent dans l’histoire de l’humanité : De l’émergence de super-puissances numériques.

Ce n’est pas la première fois que j’évoque le concept de techno-féodalisme, mais avec l’avènement de l’IA portée par les géants numériques (Comment les Big Techs vont s’accaparer le marché de l’IA) et les techno-prophètes (Des dangers du dogmatisme technologique), il prend tout son sens :

Le techno-féodalisme est un concept socio-économique qui décrit une forme de pouvoir et d’organisation sociale où les grandes entreprises technologiques exercent une domination analogue à celle des seigneurs féodaux du Moyen Âge. Dans ce modèle, les citoyens-consommateurs deviennent dépendants de plateformes numériques pour travailler, communiquer, se déplacer, se soigner, se divertir… mais sans véritable pouvoir de négociation, de propriété ou de contrôle sur les infrastructures ou les données qu’ils produisent.

Longtemps considéré comme une hypothèse, ce scénario est maintenant une réalité que nous devons accepter : Le techno-féodalisme une expression venue de la science-fiction pour désigner la mutation du capitalisme.

La question est maintenant de savoir comment nous voulons / pouvons en limiter les conséquences.

Des IA pour remplacer les salariés ou les patrons (ou les deux) ?

J’imagine que vous avez déjà dû aborder la question de nombreuses fois avec vos collègues ou proches : l’IA va-t-elle nous remplacer ?

Je ne m’attarderai pas sur cette question, car elle est extrêmement mal posée. En revanche, je suis tout à fait d’accord avec le point de vue très tranché, mais réaliste de Seth Godin sur l’évolution du rôle des cols blancs : soit l’IA travaillera pour vous, soit vous travaillerez pour l’IA (cf. Col blancs et IA générative : entre promesses d’augmentation et risques de substitution).

Cette hybridation de la force de travail est-elle un potentiel danger pour les entreprises ? Pas si les processus sont modélisés entre temps pour permettre aux agents d’en automatiser une (grande) partie : Seizing the agentic AI advantage. Cette étude de McKinsey pointe du doigt un paradoxe surprenant : les gains de performance promis ne sont pas au rendez-vous, alors que l’IA et les modèles génératifs sont de plus en plus utilisés dans les entreprises.

L’explication de ce paradoxe est simple : Les IA ne sont pas magiques, elles ne peuvent améliorer la productivité que si elles sont intégrées aux outils et fonctionnements de l’entreprise. Sinon, elles opèrent en périphérie et n’apportent que des gains non-significatifs.

La solution réside donc dans une intégration et passe par une modélisation des processus métier afin de permettre aux IA de comprendre le fonctionnement de l’entreprise (ses différentes activités) pour pouvoir l’automatiser, voir l’optimiser. La finalité d’une telle démarche d’hybridation est de créer un double numérique de l’entreprise pour pouvoir créer des doubles numériques des salariés.

Se pose alors la question de savoir qui va modéliser les processus : les salariés, des consultants externes ou l’IA elle-même ? Comme dit l’autre : « La question elle est vite répondue« .

Il existe ainsi des startups qui proposent des systèmes d’IA capables d’analyser les flux d’information et séquences de travail pour pouvoir modéliser de façon automatique les activités et les rôles des collaborateurs : Reejig Launches Work Architecture Platform To Speed Transition to AI.

Cet exemple est particulièrement intéressant, car cette startup s’appuie sur des modèles d’analyse qui ont moins de deux ans. Imaginez ce que ça va donner dans quelques années quand les modèles génératifs auront fait des progrès, et que les grands éditeurs disposeront de toutes les données nécessaires pour pouvoir modéliser de façon encore plus fine l’ensemble des activités. La clé étant d’avoir accès aux informations, données et conversations. C’est exactement ce qu’ambitionne de faire SalesForce à travers ses acquisitions : MuleSoft pour les informations, Tableau et Informatica pour les données, Slack pour les conversations… Grâce à cette vision à 360° de l’activité des entreprises, ils vont pouvoir concevoir des agents toujours plus autonomes et intelligents : Salesforce launches Agentforce 3 with AI agent observability and MCP support.

Et encore une fois, il vous faut prendre en compte le fait que nous n’avons fait qu’explorer la surface de la partie visible de l’immense iceberg que représentent les modèles génératifs, dont les capacités d’apprentissage progressent régulièrement : Beyond static AI: MIT’s new framework lets models teach themselves.

Comme vous pouvez le constater, quelle que soit la façon dont vous abordez le sujet de l’évolution des entreprises dans leur recherche de productivité, l’IA est à la fois le problème et la solution.

Rien de très surprenant dans la mesure où les ordinateurs sont de toute façon massivement déployés en entreprise (le cheval de Troie de l’IA), mais une situation potentiellement problématique dans la mesure où ces IA sont contrôlées par une poignée d’acteurs.

L’avènement de l’IA va bénéficier à tous, mais surtout aux Big Techs

Notre future dépendance aux IA est une dure réalité que nous devons accepter, car elle semble inéluctable. Ce qui n’est pas sans poser des problèmes économiques, éthiques et écologiques :

Pour bien mesurer l’ampleur du problème, ou du moins la taille des enjeux de l’avènement de l’IA, il faut prendre de la hauteur et aborder cette question d’un point de vue macro-économique, voir géopolitique : les nouveaux rapports de force qui sont en train de se mettre en place ne vont pas qu’impacter le monde de l’informatique, ils vont mener à une redistribution globale de la richesse et des pouvoirs en faveur de ceux qui maîtrisent l’IA.

Un déséquilibre potentiel qui est pointé du doigt dans le dernier rapport des Nations Unies qui nous alerte sur le fait que les écarts de développement humain, mesurés par leur Human Development Index, sont en train de se creuser et que les progrès enregistrés à l’échelle mondiale risquent de s’essouffler : Human Development Report 2025. Le principal problème qui est pointé du doigt par ce rapport est que le monde est embarqué dans une forme de fuite en avant :

« L’IA ajoute des pages confuses au manuel du développement au lieu d’en éliminer. Les voies possibles tendent à s’élargir même si elles perdent en clarté, d’autant que les capacités de l’IA restent encore largement inconnues, tout comme l’incidence qu’elle aura sur les décisions humaines. »

Mais tout n’est pas perdu, car nous pouvons encore décider de l’issu de cette course à l’IA :

“L’avenir est entre nos mains. En bâtissant une économie de complémentarité, en stimulant l’innovation avec un but et en investissant dans des capacités qui importent, les sociétés ont la possibilité d’utiliser l’IA pour élargir les choix et les perspectives des individus.”

Nous le pouvons en théorie, car en pratique, le monde est plus fragmenté que jamais, avec des grandes puissances qui tentent (et espèrent bien) d’imposer leur domination technologique à travers l’IA.

Rassurez-vous, je ne vais pas vous faire un cours d’histoire ou de géopolitique, mais comprenez bien que les enjeux de l’avènement de l’IA vont bien au-delà de la valeur boursière de telle ou telle société, il est question de Quatrième Révolution Industrielle et de l’émergence de nouvelles formes d’entreprises et surtout d’un nouveau modèle de société. Une société où les chances de réussite et d’émancipation seront encore plus inégalitaires en fonction des régions du monde (USA, Chine et Europe vs Amérique du Sud, Asie et Afrique).

La 4e Révolution Industrielle est donc en cours, ça vous le saviez déjà. La principale difficulté sur laquelle les grandes institutions planchent est de s’assurer que cette révolution va bénéficier au plus grand nombre, afin d’éviter une accélération de la concentration des richesses et pouvoirs.

Pas simple, d’autant plus que nos schémas de pensée sont petit à petit reformatés par l’IA.

L’IA serait-elle votre second ou votre premier cerveau ?

Comme je viens de le dire, ou plutôt que l’Organisation des Nations Unies l’a dit, infléchir et encadrer la montée en puissance de l’IA est possible à condition que les grandes puissances du monde (sociétés, gouvernements…) se mettent d’accord sur une ligne de conduite. Une difficulté à priori insurmontable, car les intérêts divergent et que le seul moyen d’arriver à un consensus serait d’avoir une vaste concertation pour trouver des compromis satisfaisants pour toutes les parties prenantes.

Une tâche immense, et surtout illusoire, car les débats publics et parlementaires sont paralysés par des dogmes populistes. Il en résulte un immobilisme qui frappe aussi bien les pays que les entreprises, une forme de paralysie généralisée dont bénéficient les grandes sociétés technologiques qu’on laisse prospérer dans le doute.

Le fond du problème est qu’à force de vivre dans l’instant présent et de se contenter de parer au plus urgent, nous avons visiblement perdu la faculté de prendre du recul et de réfléchir aux conséquences à long terme de nos actes et décisions. Une déficience intellectuelle que l’on retrouve à toutes les strates de la population : citoyens, dirigeants d’entreprise, étudiants, hommes et femmes politiques… toutes et tous sont piégés dans les limbes d’un quotidien qui va de mal en pis. C’est la fameuse théorie de la polycrise.

Une situation alarmante, car elle n’est pas prête de s’inverser dans la mesure où les chatbots nous invitent à la paresse intellectuelle : choisir le chemin de moindre résistance. Ainsi, pourquoi s’embêter à lire un livre ou un article en entier alors que l’on peut en demander un résumé sous forme de liste à puces à ChatGPT (cf. What’s Happening to Reading?).

Pire : nous avons maintenant un peu de recul sur l’impact de l’utilisation de l’IA : cette étude du MIT nous confirme que nous sollicitons beaucoup moins notre cerveau lorsque nous avons recours à un chatbot (Your Brain on ChatGPT: Accumulation of Cognitive Debt when Using an AI Assistant for Essay Writing Task).

Le cerveau étant comme un muscle, il y a de gros risques qu’une sous-utilisation mène à une atrophie, donc à une potentielle perte de facultés intellectuelles : ChatGPT May Be Eroding Critical Thinking Skills, According to a New MIT Study.

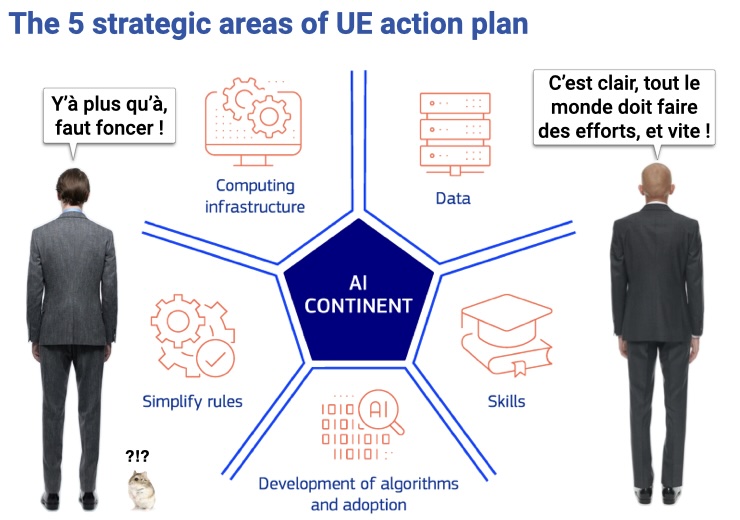

Formulé autrement : plus on utilise l’IA et plus l’IA devient indispensable. Encore un signal qui vient renforcer l’éventualité d’une hégémonie à moyen terme des chatbots et assistants. Et pendant ce temps-là, la réponse à la question de la souveraineté européenne se fait attendre. Il y a bien un code de bonne conduite et un plan d’action (General-Purpose AI Code of Practice et AI Continent Action Plan), mais tout ceci semble bien théorique.

Donc encore une fois, je vous invite fortement à vous préparer à un scénario qui ne va pas forcément vous plaire et faire grincer des dents les plus réfractaires au changement.

Dans tous les cas de figure, il est plus qu’urgent de faire monter en compétences, les équipes, les managers, mais également les dirigeants sur l’IA. Et comme j’ai régulièrement l’occasion de vous le rappeler, cette montée en compétences est freinée par une dette numérique largement sous-estimée, et qui trouve ses origines dans des lacunes informatiques qui perdurent depuis 30 ans (L’IA générative victime d’un emballement technologique et d’une adoption tardive).

D’où une nécessaire réappropriation d’outils informatiques / numériques qui font partie de notre quotidien, qui SONT notre quotidien, mais que nous n’avons jamais pris le temps d’apprivoiser (Nous n’avons pas besoin de meilleures IA, mais d’une meilleure compréhension de l’IA). Sans un plan ambitieux d’acculturation au numérique et une montée en compétences sur l’IA, nous courrons au fiasco et à l’asservissement technologique que nous craignons tous individuellement, mais que nous sommes pour le moment incapables de combattre collectivement.

Questions / Réponses

Qu’est-ce que le techno-féodalisme et pourquoi est-il inquiétant ?

Le techno-féodalisme désigne un système où quelques grandes entreprises technologiques contrôlent les plateformes et les données, rendant les utilisateurs dépendants, sans réel pouvoir de négociation. Ce modèle remet en question notre autonomie numérique et économique.

L’intelligence artificielle va-t-elle vraiment remplacer les travailleurs ?

Pas nécessairement, mais elle transformera profondément les métiers. Les IA ne sont efficaces que si elles sont intégrées aux processus. Sans cela, elles restent accessoires. L’enjeu est d’en faire des outils d’augmentation plutôt que de substitution.

Pourquoi parle-t-on d’une dépendance croissante aux IA ?

Parce que nous utilisons déjà quotidiennement des services contrôlés par une poignée d’acteurs (Google, Apple, Microsoft…). L’IA générative renforce cette dépendance en s’imposant dans tous les domaines : travail, éducation, santé, divertissement.

Quels sont les risques pour nos capacités intellectuelles ?

Le recours systématique aux IA pour simplifier les tâches mentales peut entraîner une forme de paresse cognitive. Des études montrent une baisse de sollicitation du cerveau, ce qui pourrait à terme affecter notre esprit critique et nos compétences de réflexion.

Que puis-je faire, à mon niveau, pour éviter l’asservissement technologique ?

L’action collective est difficile, car les débats sont paralysés par les résistances au changement et la dette numérique. La solution la plus urgente et la plus concrète pour les individus est une réappropriation des outils informatiques et numériques ; et pour les entreprises, un plan ambitieux d’acculturation au numérique et une montée en compétences sur l’IA.